我们擅长商业策略与用户体验的完美结合。

欢迎浏览我们的案例。

人类历史上,第一个可编程忆阻器计算机诞生,不再需要将语音命令发送到云端进行解释,直接在智能手机上通过 AI 处理器完成,极大的加快响应时间。在一些更加注重私密性的场景比如医疗设备中,具有更好的安全性和隐私性。

你有没有想过,智能手机将来也有可能直接处理复杂的人工智能任务?关键在它:人类历史上,第一个可编程忆阻器计算机。

不仅仅是通过外部计算机操作的忆阻器阵列,密歇根大学开发的这个可编程忆阻器计算机,可以直接在小型、能量受限的设备(如智能手机和传感器)上处理人工智能任务。

也就是说,在未来,不再需要将语音命令发送到云端进行解释,直接在智能手机上通过 AI 处理器完成,极大的加快响应时间。在一些更加注重私密性的场景比如医疗设备中,能够实现更好的安全性和隐私性。

人工智能强大的算力带来的负面影响之一就是巨额的能耗。每个人都希望在智能手机上安装 AI 处理器,但你肯定不希望手机一天充电 12 次。

为什么忆阻器有利于机器学习

这里提到的忆阻器的高级计算机组件,是具有存储器、可变电阻的电阻器,可用作信息存储。

由于忆阻器在同一位置存储和处理信息,因此它们可以解决掉计算速度及功耗的杀手——内存和处理器之间的连接。

这对于处理大量数据的机器学习算法尤其重要,例如识别照片和视频中的对象,或预测哪些医院患者具有较高的感染风险。

如今,程序员已经习惯于在图形处理单元(GPU)而不是 CPU 上运行这些算法。

“就功率和吞吐量而言,GPU、定制的优化数字电路被认为比 CPU 好 10 到 100 倍。”Lu 说。“忆阻器 AI 处理器可能会再好上 10 到 100 倍。”

GPU 在机器学习任务中表现优秀,因为它们有数千个小核心可以同时运行计算。忆阻器阵列则更进一步,每个忆阻器都能够独立进行计算,一个内核里可以一次性执行数千次操作。

本次用于实验的计算机拥有超过 5800 个忆阻器。而用于商业的话,可能包括数百万个。

忆阻器阵列特别适合解决机器学习任务,这是因为机器学习算法将数据转换为向量。例如,预测患者在医院的感染风险时,该向量可以将存在感染风险的因素以数字表示列出。

然后,机器学习算法将这些“输入”向量,与在存储器中的“特征”向量进行比较。如果匹配,则系统知道输入数据具有该特征。向量存储在矩阵中,类似于数学电子表格,这些矩阵可以直接映射到忆阻器阵列上。

更重要的是,当数据通过阵列反馈时,大部分数学处理通过忆阻器中的自然电阻发生,消除了将特征向量移入和移出存储器而导致的额外计算。这使得阵列在复杂的矩阵计算中非常高效。

早期的研究证明了忆阻器阵列有可能加速机器学习,但它们需要外部计算元件才能运行。

构建可编程忆阻器计算机

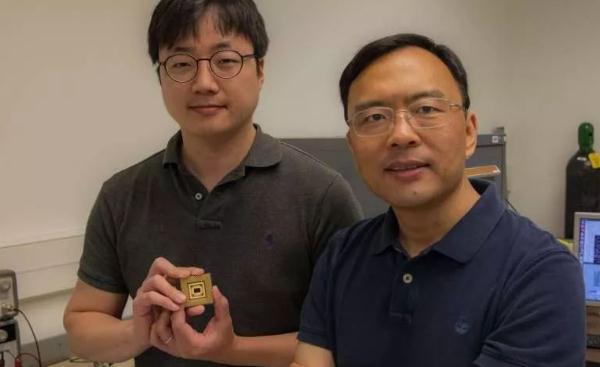

为了构建第一台可编程忆阻器计算机,Lu 的团队与U-M 的电子和计算机工程副教授 Zhengya Zhang 和 Michael Flynn 教授一起设计了一个芯片,可以将忆阻器阵列与编程和运行所需的所有其他元件集成在一起。

这些组件包括传统的数字处理器和通信通道,以及数字/模拟转换器,用作模拟忆阻器阵列和计算机其余部分之间的解释器。

然后,Lu 的团队将忆阻器阵列直接集成在U-M 的 Lurie Nanofabrication Facility 的芯片上。他们还开发了将机器学习算法映射到忆阻器阵列的矩阵结构上的软件。

该团队使用三种基本机器学习算法演示了该设备:

感知机(Perceptron),用于对信息进行分类。能够 100% 准确地识别出不完美的希腊字母

稀疏编码,压缩并分类数据,特别是图像。计算机能够找到最有效的方法来重建一组图像,并以 100% 的准确度识别出其模式

双层神经网络,旨在寻找复杂数据中的模式。这个双层网络在乳腺癌筛查数据中找到了共性和差异因素,然后将每个病例分类为恶性或良性,准确率为 94.6%

扩展商业用途存在挑战。但 Lu 计划将这项技术商业化。该研究的标题是“完全集成的可重编程忆阻器-CMOS 系统,用于高效的乘法累加运算。”

(邯郸网站建设)